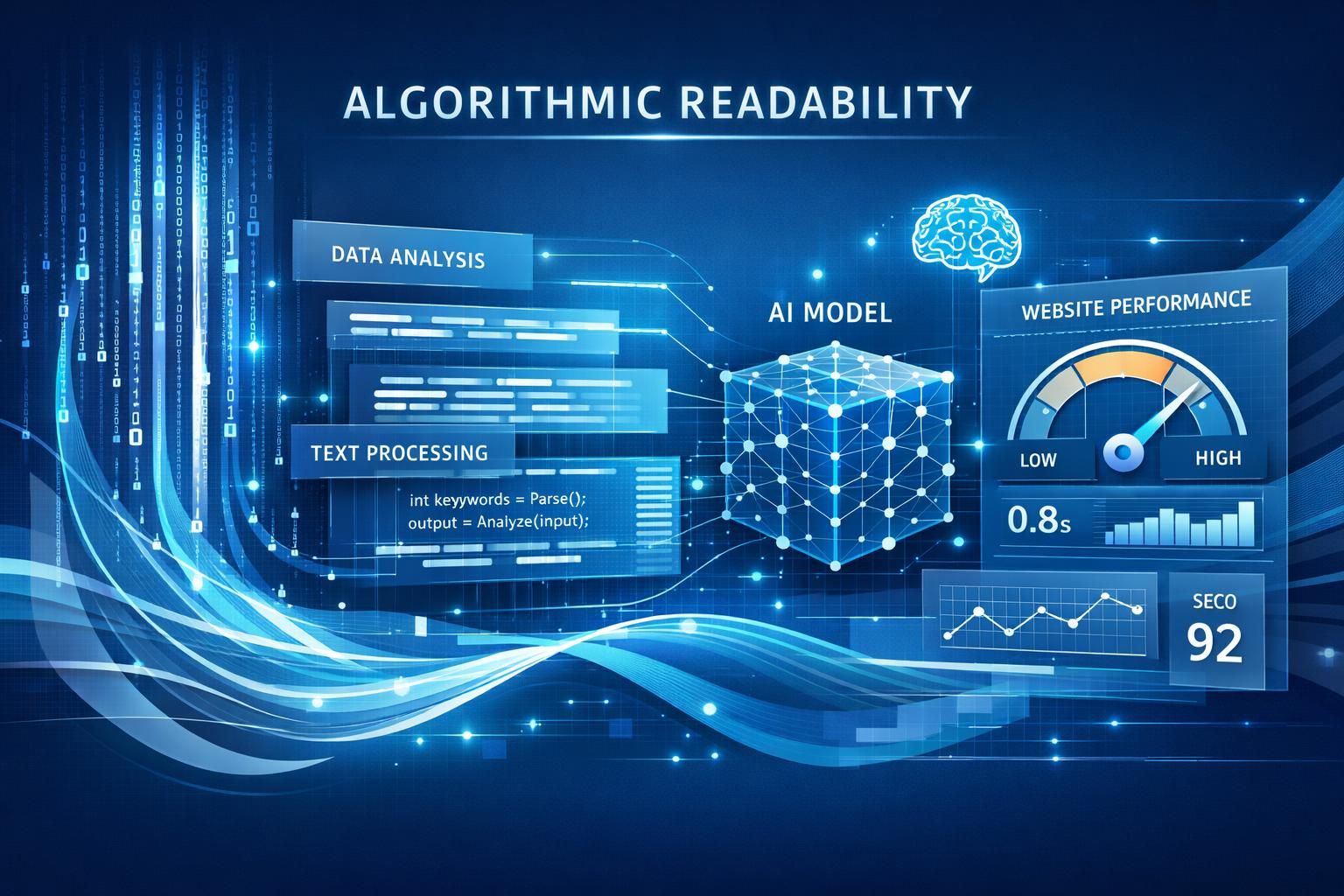

Warum wird algorithmische Lesbarkeit zu einem zentralen Performancefaktor? Digitale Verlage, Plattformbetreiber und Marketingteams beobachten seit 2026, wie algorithmische Lesbarkeit zunehmend über Sichtbarkeit entscheidet: Suchmaschinen und KI-gestützte Discovery-Systeme werten Inhalte nicht mehr nur nach Keywords, sondern nach maschinenlesbarer Struktur, klarer Sprache und messbarer Leserlichkeit. Dieser Wandel betrifft Suchmaschinenoptimierung, redaktionelle Workflows und technische Datenverarbeitung gleichermaßen.

Warum algorithmische Lesbarkeit den neuen Performancefaktor für Suchmaschinenoptimierung darstellt

Plattformen wie Google und Anbieter von KI-Retrieval-Systemen priorisieren seit der Integration von generativen Modellen zunehmend Inhalte, die sich leicht parsen und semantisch einbetten lassen. Das macht die klassische Keyword-Orientierung allein weniger entscheidend.

Problem: traditionelle SEO trifft auf neue Ranking-Logiken

SEO-Metriken, die auf Backlinks und Keyword-Dichte basieren, greifen nicht mehr uneingeschränkt, wenn ein Algorithmus Inhalte nach ihrer maschinenlesbaren Struktur bewertet. Das verschärft den Druck auf Redaktionen und Onlinemarketer.

Lösung: Lesbarkeit als messbare Metrik

Tools wie Yoast (WordPress-Plugin) oder Grammarly bieten bereits Lesbarkeitschecks; ihre Funktionen werden nun mit Embedding- und Strukturtests kombiniert. Dadurch wird Content-Optimierung technischer und mehrstufiger.

Wie Textanalyse und Datenverarbeitung Lesbarkeit operationalisieren

Die Verbindung aus Textanalyse, NLP-Embeddings und schnellen Datenverarbeitung-Pipelines erlaubt es Suchsystemen, Inhalte automatisiert zu bewerten. Dabei zählen eindeutig strukturierte Abschnitte, kurze Sätze und semantische Markierungen.

Technischer Kontext und Forschung

Grundlagen aus der Algorithmus-Effizienz und Komplexitätstheorie befördern effiziente Parsersysteme; Forschung zur Optimierung von Rechenressourcen bleibt relevant, weil große Modelle teure Infrastruktur benötigen. In der Praxis bedeutet das: besser strukturierte Inhalte sparen Rechenzeit bei der Indexierung.

Praxisbeispiel: Redaktionen und CMS

WordPress-Nutzer, die Yoast mit KI-gestützten Editoren wie TextCortex kombinieren, melden schnellere Workflows bei der Content-Optimierung. Eine Studie, auf die sich Branchenberichte beziehen, zeigte, dass leserlichere Artikel die Verweildauer um rund 20 % steigern können — ein Indikator für bessere Nutzerbindung und indirekt höhere Rankings.

Konkrete Folgen für Website-Performance, Nutzerfreundlichkeit und Geschäftsmodelle

Die Konzentration auf Leserlichkeit verändert technische Prioritäten: neben Ladezeiten gewinnt die semantische Zugänglichkeit an Gewicht. Unternehmen müssen deshalb Website-Performance und inhaltliche Struktur gleichermaßen optimieren.

Auswirkungen auf UX und Monetarisierung

Verbesserte Benutzerfreundlichkeit durch klare Gliederung und prägnante Sprache erhöht Klick- und Conversion-Raten. Publisher, die strukturierte Metadaten und standardisierte Inhaltsblöcke einsetzen, erleichtern KI-Systemen das Extrahieren relevanter Snippets für Antwortboxen.

Beispiele aus der Branche

SEO-Agenturen und Plattformbetreiber wie Microsoft (Bing) und Google empfehlen inzwischen, Inhalte für maschinelle Lesbarkeit zu strukturieren; Tools zur Analyse werden in Redaktions-Workflows integriert. Das Ergebnis: technisches SEO und redaktionelle Qualität müssen Hand in Hand gehen, damit ein Artikel in systembasierten Discovery-Kanälen gesehen wird.

Im laufenden Wandel hin zu KI-gestützter Suche bleibt algorithmische Lesbarkeit ein zentraler Hebel: wer Inhalte systematisch lesbar, semantisch markiert und technisch performant ausliefert, verbessert sowohl die Website-Performance als auch die Chancen in modernen Discoverysystemen. Die nächste Herausforderung für 2026 wird sein, Lesbarkeitstools mit messbaren KPIs in Redaktions- und Entwicklungsprozesse zu integrieren, um langfristig Sichtbarkeit und Nutzerbindung zu sichern.